中科院计算所的处理器芯片全国重点实验室及其合作单位,用AI技术设计出了世界上首个无人工干预、全自动生成的CPU芯片——启蒙1号。

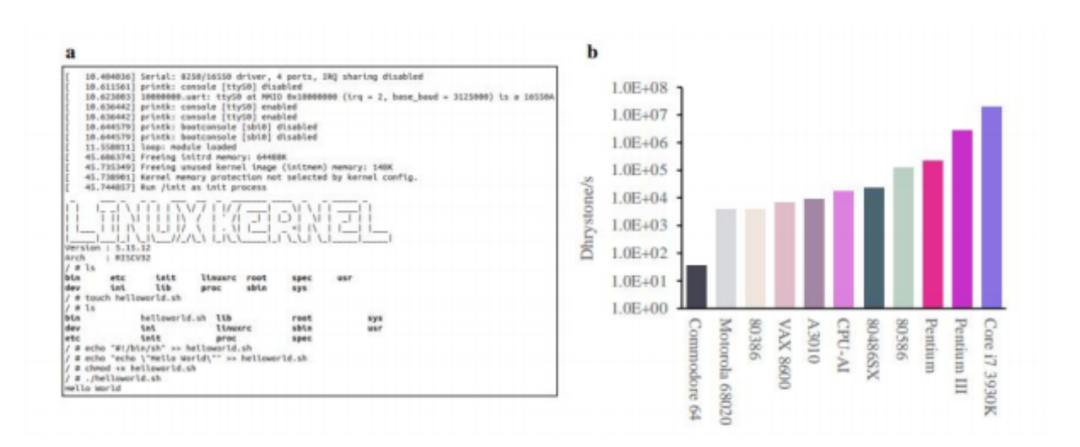

这颗完全由AI设计的32位RISC-V CPU,相比GPT-4目前所能设计的电路规模大4000倍,并可运行Linux操作系统,且性能堪比Intel 486。

启蒙1号处理器是基于RSIC-V指令集的,32位架构,早在2021年12月就已经完成流片验证,之后中科院计算所还用它点亮了Linux操作系统,并运行了SPEC CPU2000测试程序,评估后认为性能跟Intel的40486相当。

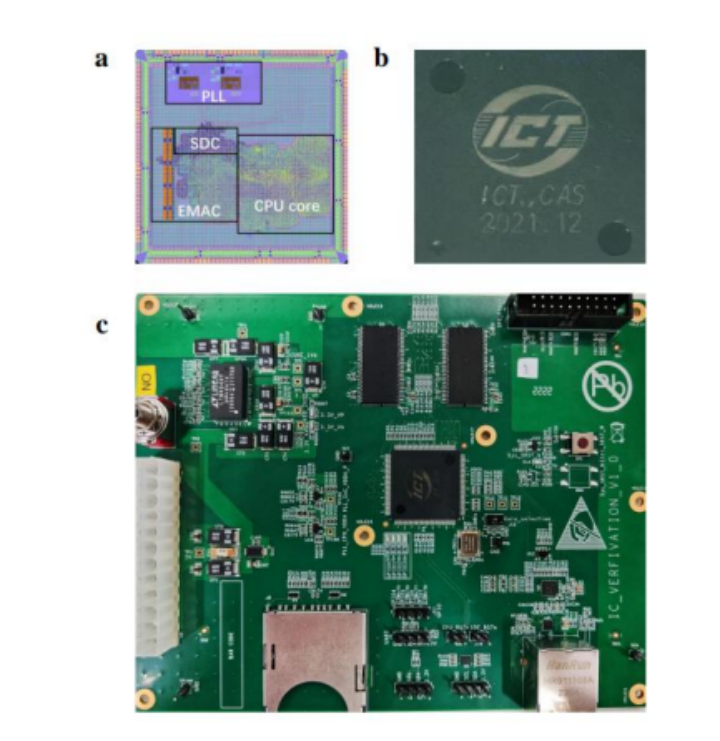

启蒙1号芯片版图及实物图,其中CPU核部分完全由算法自动生成,芯片于2021年12月采用65nm工艺流片,运行频率300MHz

这是全球首个无人工干预、全自动生成的CPU芯片,65nm工艺,频率达到了300MHz,相关研究论文已经发表。

启蒙1号是中科院研究人员基于BSD二元猜测图(Binary Speculation Diagram, 简称BSD)算法设计出来的,5个小时就生成了400万逻辑门,这个规模比GPT-4能设计的芯片大4000倍。

虽然启蒙1号CPU的规模跟当前的顶级CPU还没法比,但是AI技术的进步飞快,未来AI设计芯片会成为主流,将极大地提高芯片设计效率。

自2008年起,中科院计算所便开始长期从事芯片设计和人工智能的交叉研究。其中一项为人熟知的产出就是人工智能芯片寒武纪。

而在面向芯片设计的人工智能方法上,中科院计算所也已有十多年的积累,并且从未停止探索如何用人工智能方法使得芯片设计完全自动化。

依托中国科学院计算技术研究所建立的处理器芯片全国重点实验室,是中国科学院批准正式启动建设的首批重点实验室之一,并被科技部遴选为首批 20个标杆全国重点实验室,2022年5月开始建设。

其中,实验室学术委员会主任为孙凝晖院士,实验室主任为陈云霁研究员。

实验室近年来获得了处理器芯片领域首个国家自然科学奖等6项国家级科技奖励;在处理器芯片领域国际顶级会议发表论文的数量长期列居中国第一;在国际上成功开创了深度学习处理器等热门研究方向;孵化了总市值数千亿元的国产处理器产业头部企业。

日前,国际上也有使用ChatGPT设计芯片的尝试。纽约大学 Tandon 工程学院的研究人员使用简单的英语“对话”与 AI 模型制造了一个微处理芯片,这是一项史无前例的成就,可以加快芯片开发速度,更重要的是这将允许没有专业技术技能的个人设计芯片。

两名硬件工程师使用标准英语与ChatGPT-4“交谈”,并设计了一种新型的微处理器架构。研究团队和 ChatGPT 设计的芯片并不是一个完整的处理器,它是整个 CPU 的一个部分:负责创建一个新颖的基于 8 位累加器的微处理器架构的逻辑。该芯片随后被送往Skywater 130 nm 光刻机上进行制造。该团队声称,这项研究标志着 LLM 设计的 IC 首次真正投入生产。

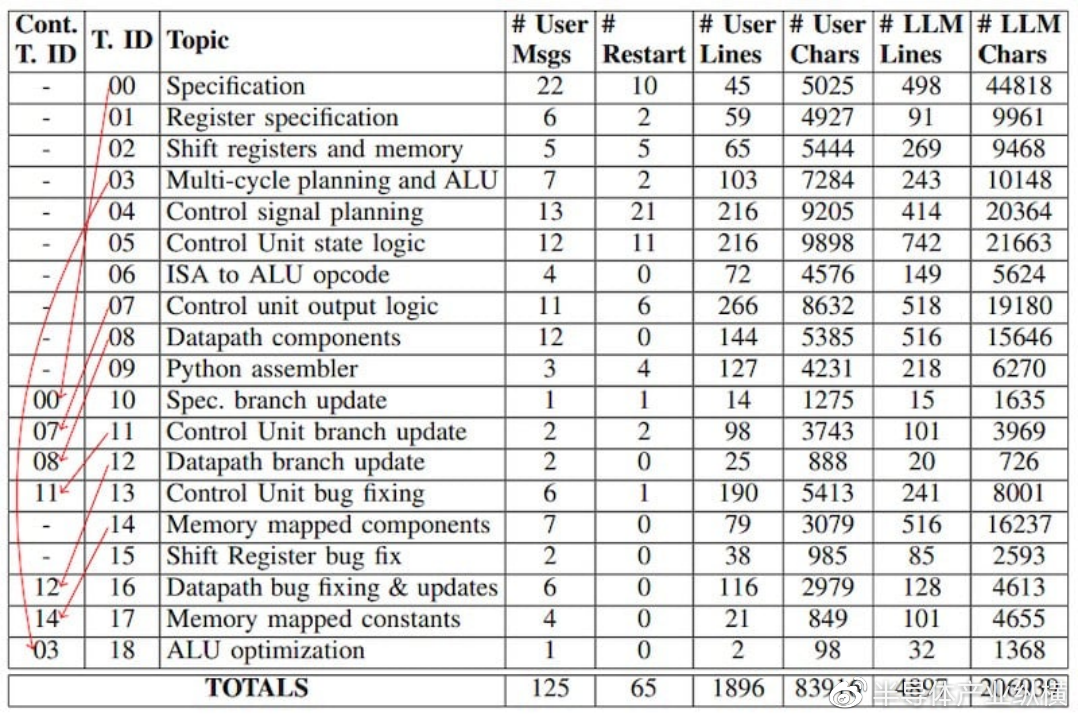

该团队使用了125条消息成功的创建了他们的IC

累加器本质上是寄存器(内存),其中存储中间计算的结果,直到主计算完成。但它们是 CPU 工作方式不可或缺的一部分;也许还可以设计其他必要的单元。这一成果表明,未来成为 EDA 设计师的知识门槛要低得多。也许有一天,足够多的 CPU 碎片会被公开,这样更多的ChatGPT用户将可以在家里设计他们的 CPU 架构。

研究人员使用商业和公开可用的大型语言模型 (LLM) 来研究八个硬件设计示例,在工程师和 LLM 之间的实时来回交互中,通过纯英文文本处理其 Verilog (HDL) 等效。

“这项研究产生了我们认为是第一个完全由 AI 生成的 HDL,用于制造物理芯片,”纽约大学 Tandon 的研究助理教授兼研究团队成员 Hammond Pearce 博士说。“一些人工智能模型,如 OpenAI 的 ChatGPT 和谷歌的 Bard,可以生成不同编程语言的软件代码,但它们在硬件设计中的应用尚未得到广泛研究。这项研究表明 AI 也可以使硬件制造受益,尤其是当它被用于对话时,你可以通过一种有来有往的方式来完善设计。”

从这个实验中,该团队得出结论,ChatGPT 确实可以将功能芯片设计为现实世界的解决方案。

*声明:本文系原作者创作。文章内容系其个人观点,我方转载仅为分享与讨论,不代表我方赞成或认同,如有异议,请联系15950995158。